徒手打造基于Spark的数据工厂 从设计到实现数据分析和存储服务

随着大数据时代的到来,企业对于高效、可扩展的数据处理需求日益增长。Apache Spark凭借其强大的分布式计算能力和易用性,成为构建数据工厂(Data Factory)的理想选择。本文将详细介绍如何从零开始设计和实现一个基于Spark的数据工厂,涵盖数据分析和存储服务的核心环节。

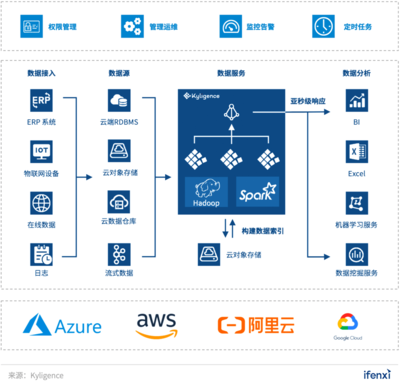

1. 数据工厂设计概述

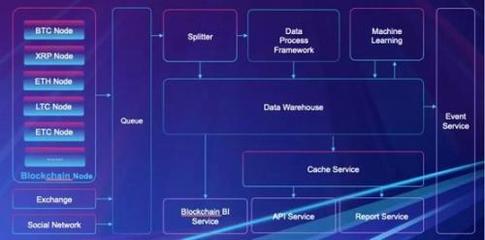

数据工厂是一个集数据采集、处理、分析和存储于一体的平台,其核心目标是为企业提供可靠的数据服务。在设计阶段,需明确以下关键组件:

- 数据源接入:支持多种数据源,如数据库、日志文件、实时流数据等。

- 数据处理引擎:基于Spark进行分布式计算,实现ETL(提取、转换、加载)操作。

- 数据分析模块:利用Spark MLlib或SQL进行数据挖掘和机器学习任务。

- 数据存储服务:将处理后的数据持久化到HDFS、数据湖或云存储中。

- 调度与监控:使用工具如Apache Airflow进行任务调度,并集成监控告警机制。

2. 实现步骤详解

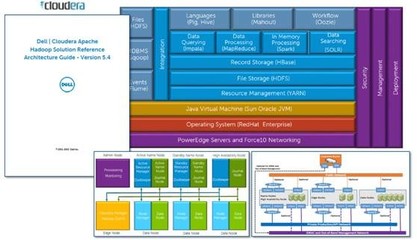

2.1 环境搭建与Spark配置

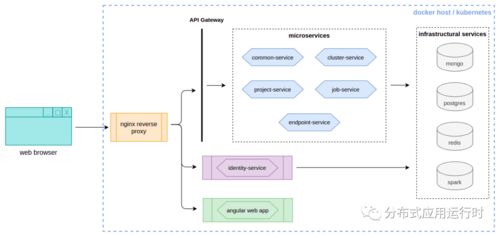

部署Spark集群,可选择Standalone、YARN或Kubernetes模式。配置Spark参数以优化资源利用,例如设置executor内存、并行度等。确保集群支持Scala、Python或Java开发,以适应不同团队需求。

2.2 数据采集与接入

通过Spark的DataSource API或自定义连接器,接入结构化数据(如MySQL、PostgreSQL)和非结构化数据(如JSON、CSV文件)。对于实时数据流,可结合Spark Streaming或Structured Streaming处理Kafka等消息队列数据。

2.3 核心数据处理

利用Spark DataFrame和SQL进行数据清洗、转换和聚合。例如,处理缺失值、去重、数据格式标准化等。编写可重用的ETL作业,确保数据质量。代码示例如下(使用PySpark):`python

from pyspark.sql import SparkSession

spark = SparkSession.builder.appName("DataFactory").getOrCreate()

df = spark.read.format("csv").load("datasource.csv")

dfcleaned = df.dropDuplicates().fillna({"columnname": "defaultvalue"})

dfcleaned.write.parquet("outputpath")`

2.4 数据分析服务

集成Spark MLlib进行机器学习任务,如分类、聚类或推荐系统。同时,使用Spark SQL执行复杂查询,生成业务报表。通过REST API或可视化工具(如Grafana)暴露分析结果,赋能决策。

2.5 数据存储与优化

将处理后的数据存储到分布式文件系统(如HDFS)或云存储(如AWS S3)。针对不同场景选择合适的存储格式,如Parquet用于分析、Avro用于序列化。实施分区和压缩策略以提升查询性能。

2.6 调度与运维

使用Apache Airflow或类似工具编排数据管道,设置依赖关系和定时任务。集成监控系统(如Prometheus)跟踪作业状态和资源使用情况,确保高可用性和故障恢复。

3. 挑战与最佳实践

在实现过程中,可能面临数据一致性、性能瓶颈等问题。建议遵循以下最佳实践:

- 采用增量处理减少资源消耗。

- 实施数据版本控制以管理变更。

- 定期进行性能调优和测试。

通过本文的指导,您可以逐步构建一个健壮的基于Spark的数据工厂,实现高效的数据分析和存储服务,助力企业数据驱动决策。

如若转载,请注明出处:http://www.xspush.com/product/6.html

更新时间:2026-04-14 13:22:25